超声成像因其成本低、无辐射、连续动态记录等优点而被广泛应用于医疗诊断。然而,由于其固有的技术限制,面临着以下挑战:

- 由于Low-cost、声衍射极限和噪声等限制,超声图像通常存在细节扭曲、低分辨率的问题

- 传统监督学习方法需要处理数百个超声帧,带来巨大的计算负担和数据处理时间

- 数据采集时间长(几秒到几十秒)增加了对组织和呼吸运动的敏感性,zao cheng l

- 真实医疗场景中缺乏低分辨率-高分辨率(LR-HR)样本对

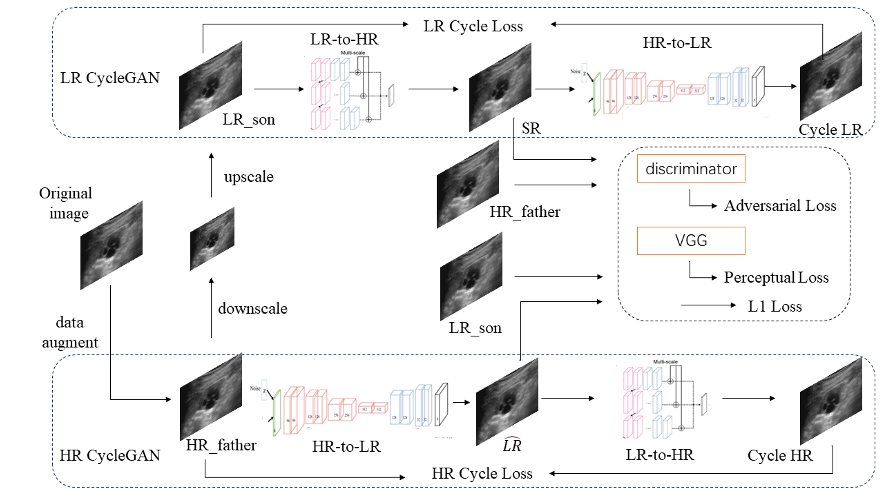

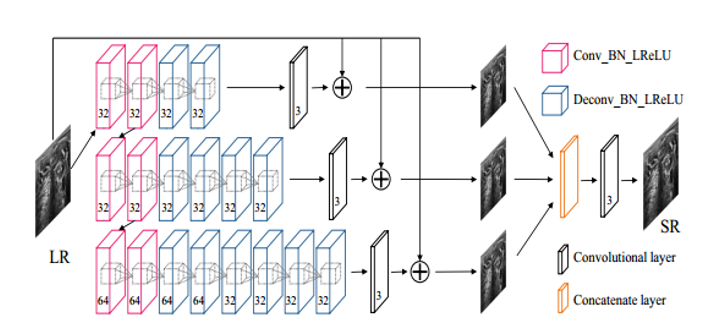

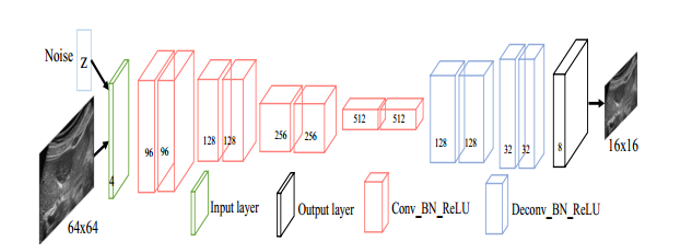

针对真实场景中超声图像鲜有LR-HR对的情况,基于ZSSR、CycleGan提出的自监督超分辨率模型

超声成像因其成本低、无辐射、连续动态记录等优点而被广泛应用于医疗诊断。然而,由于其固有的技术限制,面临着以下挑战:

✦ 来自10名不同年龄和体重的志愿者

✦ 包含84张颈总动脉(CCA)超声图像

✦ 由SonoSkills和Hitachi Medical Systems Europe提供

✦ 包含125张肝脏、心脏和纵隔等超声图像

基于双向CycleGAN的自监督生成式神经网络,通过创新性的架构设计和学习范式,实现IFC较ZSSR提升133.8%的突破性成果

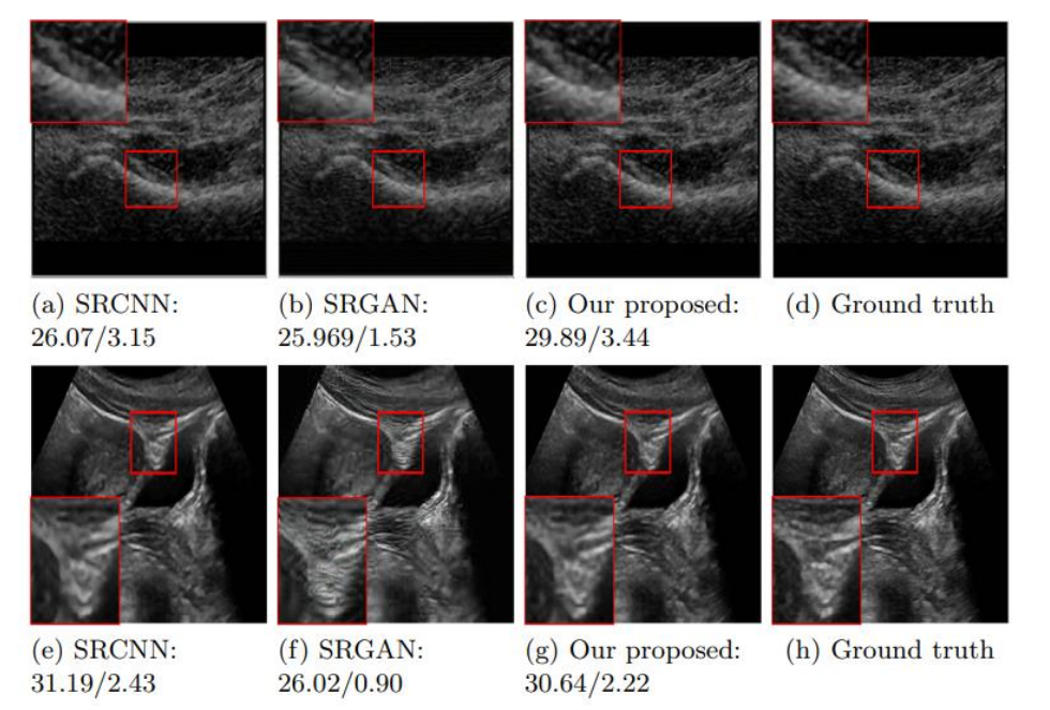

在US-CASE和CCA-US两个数据集上,我们的模型相比现有方法取得了显著的性能提升

| Dataset | US-CASE | CCA-US | ||

|---|---|---|---|---|

| PSNR | SSIM | PSNR | SSIM | |

| Bicubic | 20.721 | 0.685 | 25.984 | 0.766 |

| SRCNN | 20.639 | 0.696 | 25.352 | 0.756 |

| SRGAN | 24.318 | 0.855 | 27.917 | 0.900 |

| Our proposed | 29.492 | 0.858 | 33.835 | 0.901 |

| Dataset | US-CASE | CCA-US | ||

|---|---|---|---|---|

| PSNR | IFC | PSNR | IFC | |

| SRFeat | 24.402 | 1.139 | 26.815 | 1.144 |

| EDSR | 23.747 | 0.953 | 25.768 | 0.989 |

| ZSSR | 32.017 | 1.108 | 34.184 | 1.058 |

| Our proposed | 31.884 | 2.590 | 34.558 | 2.246 |